北京量子信息科学研究院相干原子系统的量子测量与操控团队实现自适应AI量子比特读出与FPGA硬件加速

近日,北京量子信息科学研究院(以下简称“量子院”)相干原子系统的量子测量与操控团队在面向量子比特荧光读出的自适应AI识别和低延迟硬件加速方面取得新进展。2026年5月1日,相关成果以“面向量子比特荧光读出的曝光感知卷积神经网络模型及其FPGA加速实现”(Field-programmable gate array–accelerated exposure-aware convolutional neural network for fluorescence-based qubit readout)为题,发表在《物理评论应用》(Physical Review Applied)上。

量子计算正从单个量子比特和量子门性能提升,迈向大规模可编程运行和量子纠错;与此同时,经典系统也从产生预设控制脉冲、采集实验数据和离线分析的辅助设备,转向量子计算运行闭环中的实时信息处理核心。在实时量子纠错和动态量子线路中,经典侧需要持续接收测量结果,在有限时间内完成状态识别、误差判断和反馈决策,并将结果重新作用于量子硬件。传统测控体系在自适应能力、处理吞吐量和确定性低延迟方面逐渐面临瓶颈。

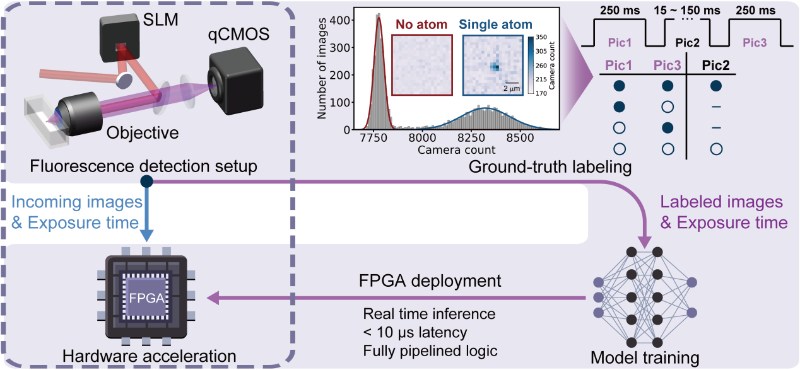

量子比特读出是量子与经典系统之间的信息接口,也是后续误差诊断、解码和反馈控制的基础。在中性原子和囚禁离子体系广泛采用的荧光读出中,AI模型能够从复杂噪声背景和有限光子信号中提取判别特征,提高量子态识别的准确性。然而,真实实验环境并非固定不变,曝光时间、背景噪声等因素都会导致数据分布变化。因此,面向未来量子纠错和动态量子线路的AI模型,不仅要准确,还需要具备对实验条件变化的自适应能力,并能够嵌入低延迟、确定性的硬件处理链路。

针对量子比特荧光读出方法,研究团队提出了一种“曝光感知”的自适应卷积神经网络。荧光读出通常通过相机图像中的光子信号判断量子比特状态:较长曝光时间有助于提高读出准确率,但会增加测量时间;较短曝光时间有利于实时反馈,却更容易受到光子数不足和噪声涨落的影响。

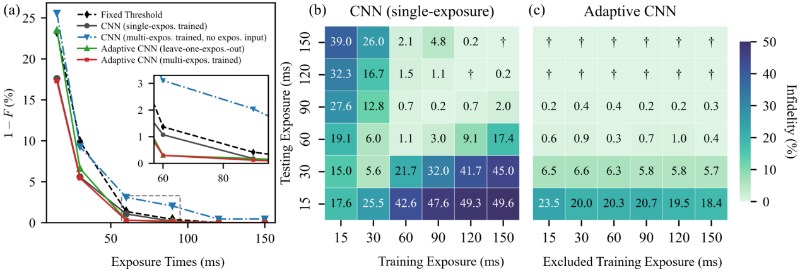

研究团队的核心思路是让AI模型不仅“看到图像”,也“知道图像是在什么实验条件下获得的”。团队将曝光时间作为上下文信息输入神经网络,使模型能够根据不同曝光条件自动调整判别规则。实验结果表明,该方法能够在多个曝光时间下保持稳定读出性能,并在未参与训练的曝光条件下展现出良好的泛化能力,从而减少对逐条件训练和标定的依赖。

模型性能比较表明,普通卷积神经网络在训练曝光时间和测试曝光时间不匹配时性能明显下降;相比之下,引入曝光时间输入后的自适应模型能够在更宽曝光范围内保持稳定读出性能,体现出对实验条件变化的鲁棒性。

对于量子纠错和中途测量反馈而言,仅有高识别准确率仍然不够,AI模型还需要嵌入量子-经典处理链路,在严格时间预算内完成推理。为此,研究团队进一步将曝光感知AI模型部署到现场可编程门阵列(FPGA)上。与依赖CPU/GPU的通用计算链路相比,该方案将推理尽可能前移到靠近实验数据采集和控制系统的硬件端,减少测量数据在不同计算单元之间传输以及主机调度带来的额外开销。团队在FPGA平台上实现了9.85微秒的单次推理延迟,相比高性能CPU和GPU通用计算方案,推理速度提升约30倍,同时保持了与原始神经网络模型相当的识别精度。

该工作不仅提升了荧光图像识别速度,更以量子比特荧光读出为验证场景,展示了“上下文感知AI模型”与“FPGA低延迟硬件部署”相结合的量子-经典协同处理思路。未来,类似方法有望拓展到更复杂的量子实验环境,推动AI模型从离线分析工具发展为服务实验运行过程的在线智能模块,为AI for Quantum在实时感知、判断和反馈中的应用提供参考。

该论文第一作者为量子院助理研究员苏晓禄和梁明诚,通讯作者为量子院苏晓禄和量子院兼聘/清华大学尤力教授。合作者还包括清华大学张腾宇、杨运坤,以及量子院博士后殷鹏(已出站)、助理研究员李相良,量子院实习生赵正然、代文青、罗小琴。该工作得到国家自然科学基金和国家重点研发计划“量子调控与量子信息”、“引力波探测”重点专项的支持。