在d+1空间中重新定义神经算子

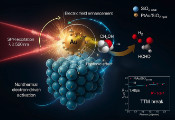

神经网络算子已成为学习函数空间之间映射的强大工具。其中,核积分算子在普遍逼近各种算子方面得到了广泛验证。尽管基于此定义的最新进展已经开发出有效模块,以更好地逼近定义在原始域(具有d维,d=1, 2, 3...)上的核函数,但嵌入空间中未明确的演化机制阻碍了研究人员设计能够完全捕捉目标系统演化的神经网络算子。借鉴最近在偏微分方程(PDEs)量子模拟方面的突破,该团队阐明了神经网络算子中的线性演化过程。基于此,研究人员在一个新的d+1维域上重新定义了神经网络算子。在此框架内,该工作实现了所提出的薛定谔化核神经网络算子(SKNO),使其更好地与d+1维演化对齐。在实验中,该团队提出的d+1维演化线性模块表现远优于其他方法。此外,研究人员在各种基准测试和零样本超分辨率任务中测试了SKNO的SOTA性能。此外,该工作还分析了在重新定义的NO框架内,不同的提升和恢复算子对预测的影响,反映了该模型与底层d+1维演化之间的对齐性。